¿Qué es Sora? ¿Un modelo de IA de texto a video?

Entrenamos IA para comprender y replicar la dinámica del mundo físico, buscando desarrollar modelos que ayuden a las personas a enfrentar desafíos que requieren interacción con el mundo real.

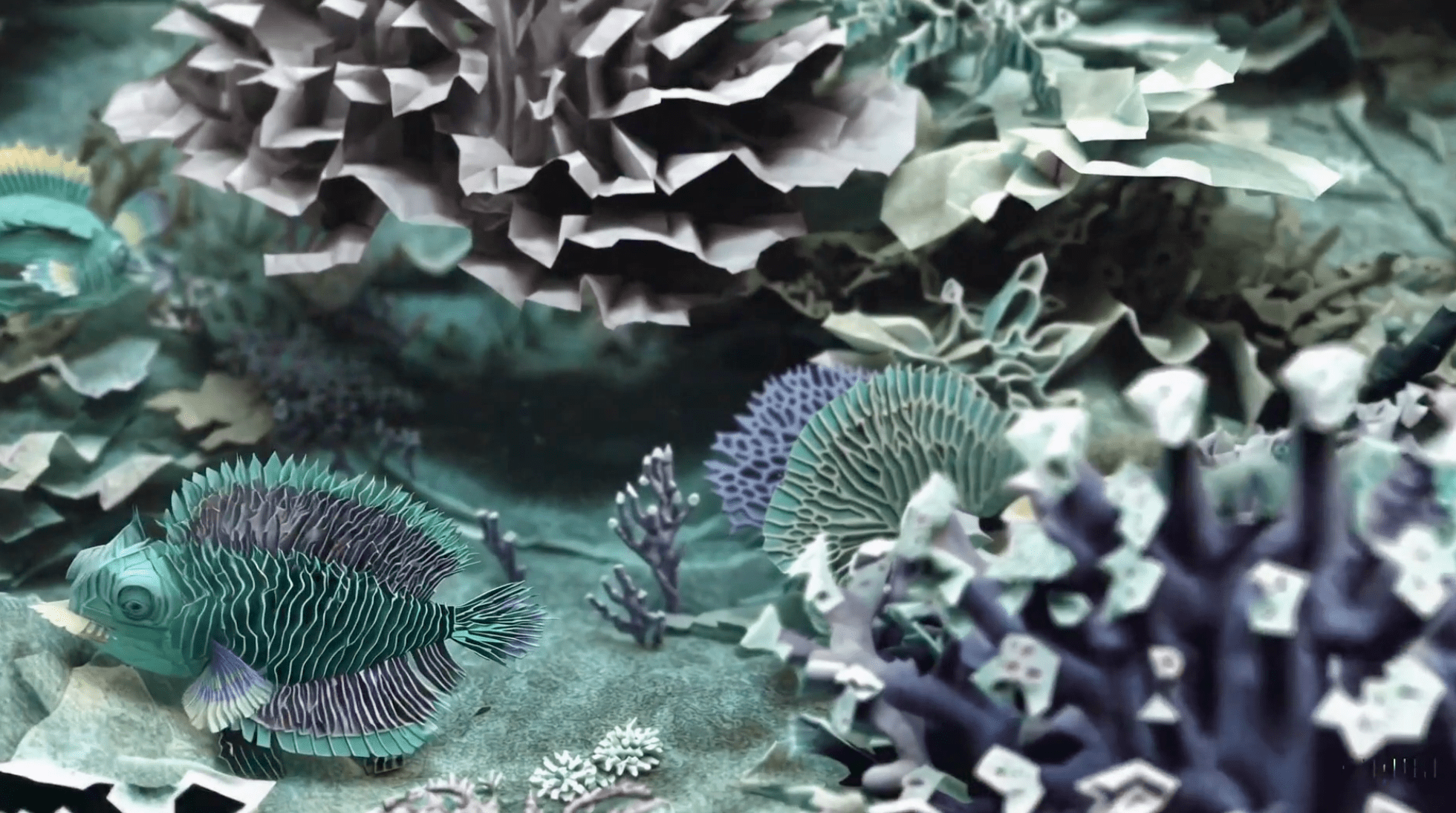

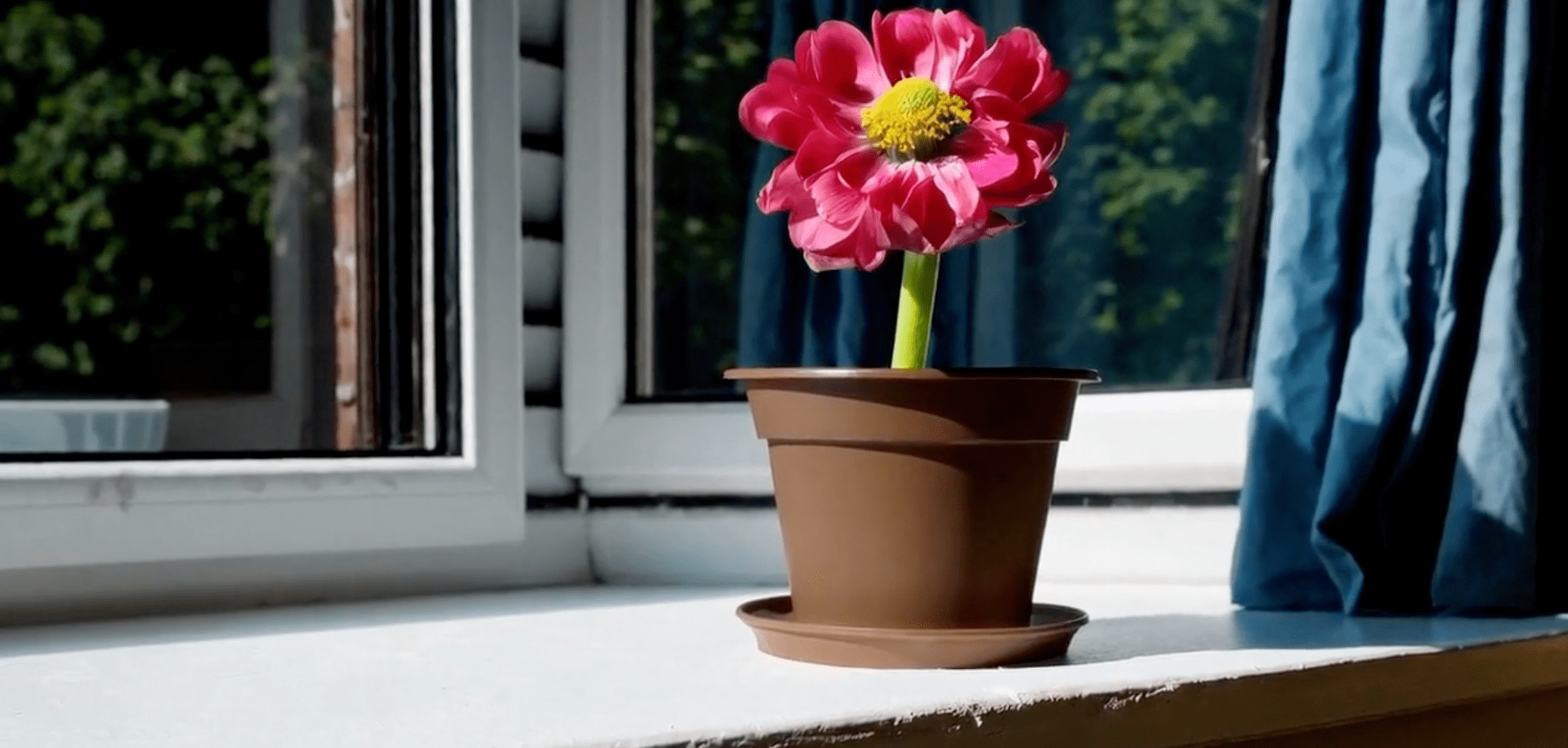

Este modelo de IA, llamado así por la palabra japonesa para "cielo", puede crear videos realistas e imaginativos a partir de texto.

Entrenamos IA para comprender y replicar la dinámica del mundo físico, buscando desarrollar modelos que ayuden a las personas a enfrentar desafíos que requieren interacción con el mundo real.

Hoy marca un hito importante con Sora saliendo a la luz, extendiéndose a equipos de seguridad ('red teamers') para identificar posibles riesgos en áreas clave. Pero eso no es todo. Invitamos también a virtuosos visuales, diseñadores y cineastas a contribuir en la evolución de Sora y convertirlo en una herramienta indispensable.

Al abrir nuestras investigaciones antes de tiempo, fomentamos el intercambio dinámico de ideas más allá de OpenAI. No solo se trata de mostrar novedades tecnológicas, sino de inspirar y visibilizar lo que es posible.

Sora puede elaborar escenas complejas con múltiples personajes, movimientos variados y detalles precisos tanto del sujeto como del fondo. El modelo comprende matices de los elementos presentes en el mundo real, garantizando realismo y precisión.

Gracias a su comprensión del lenguaje, decodifica indicaciones y crea personajes cautivadores llenos de emoción. Integra múltiples escenas en un solo video, asegurando consistencia visual y de personajes.

El modelo actual tiene limitaciones. Puede fallar al simular física compleja y podría no captar relaciones causa-efecto. Por ejemplo, puede aparecer una persona mordiendo una galleta y en la siguiente escena no faltar el pedazo.

También puede confundirse con la orientación espacial y equivocarse entre izquierda y derecha, además de tener problemas en describir eventos a lo largo del tiempo, como seguir una trayectoria de cámara.

Sora emplea un modelo de difusión, refinando videos desde ruido estático. Previene varios fotogramas para asegurar consistencia de sujetos. Usa arquitectura tipo transformer como GPT y representa datos visuales en fragmentos, logrando escalabilidad. Se apoya en recaptions de DALL·E 3 para interpretar con fidelidad las instrucciones. Puede generar videos de texto, animar imágenes fijas y extender videos. Así avanza hacia comprender y simular el mundo real: paso clave hacia la IA general (AGI). Más información: https://openai.com/sora

Desafortunadamente, hasta el 16 de febrero de 2024, el modelo Sora aún no está disponible públicamente. Solo se utiliza para investigación interna, sin fecha de lanzamiento confirmada.

Acceso limitado: OpenAI lo compartió primero con 'red teamers' (expertos en desinformación, sesgo) y algunos creativos.

Disponibilidad futura: OpenAI pretende compartir avances y quizá abrir el acceso, pero no hay planes concretos.

Alternativas: Existen opciones para generar imágenes o animaciones como Dream by WOMBO, NightCafe Creator y DALL-E 2 (acceso acotado). Pero aún no generan videos completos como Sora. Si bien no es posible usar Sora directamente:

Mantente informado: revisa el blog y redes sociales de OpenAI para novedades. Prueba las alternativas mencionadas y aprende de artículos y videos sobre Sora. Aunque no podamos usarlo aún, ¡es emocionante ver hacia dónde evoluciona!