O que é Sora? Um modelo de IA de texto a vídeo?

Estamos treinando IA para compreender e replicar a dinâmica do mundo físico, visando desenvolver modelos que ajudem pessoas em desafios do mundo real.

Este modelo de IA, chamado de "céu" em japonês, cria vídeos realistas e criativos a partir de descrições textuais.

Estamos treinando IA para compreender e replicar a dinâmica do mundo físico, visando desenvolver modelos que ajudem pessoas em desafios do mundo real.

Hoje marca um marco importante: o Sora entra em destaque, sendo estendido a revisores red team para detectar riscos e vulnerabilidades em áreas críticas. Além disso, convidamos virtuoses visuais, designers e contadores de histórias para participar da evolução do Sora, tornando-o indispensável para profissionais criativos.

Ao antecipar nossos esforços de pesquisa, não apenas convidamos à colaboração, mas promovemos um intercâmbio de ideias com pessoas fora da OpenAI. Não se trata só de mostrar o que há de mais novo em IA, mas de inspirar imaginações e iluminar as possibilidades futuras.

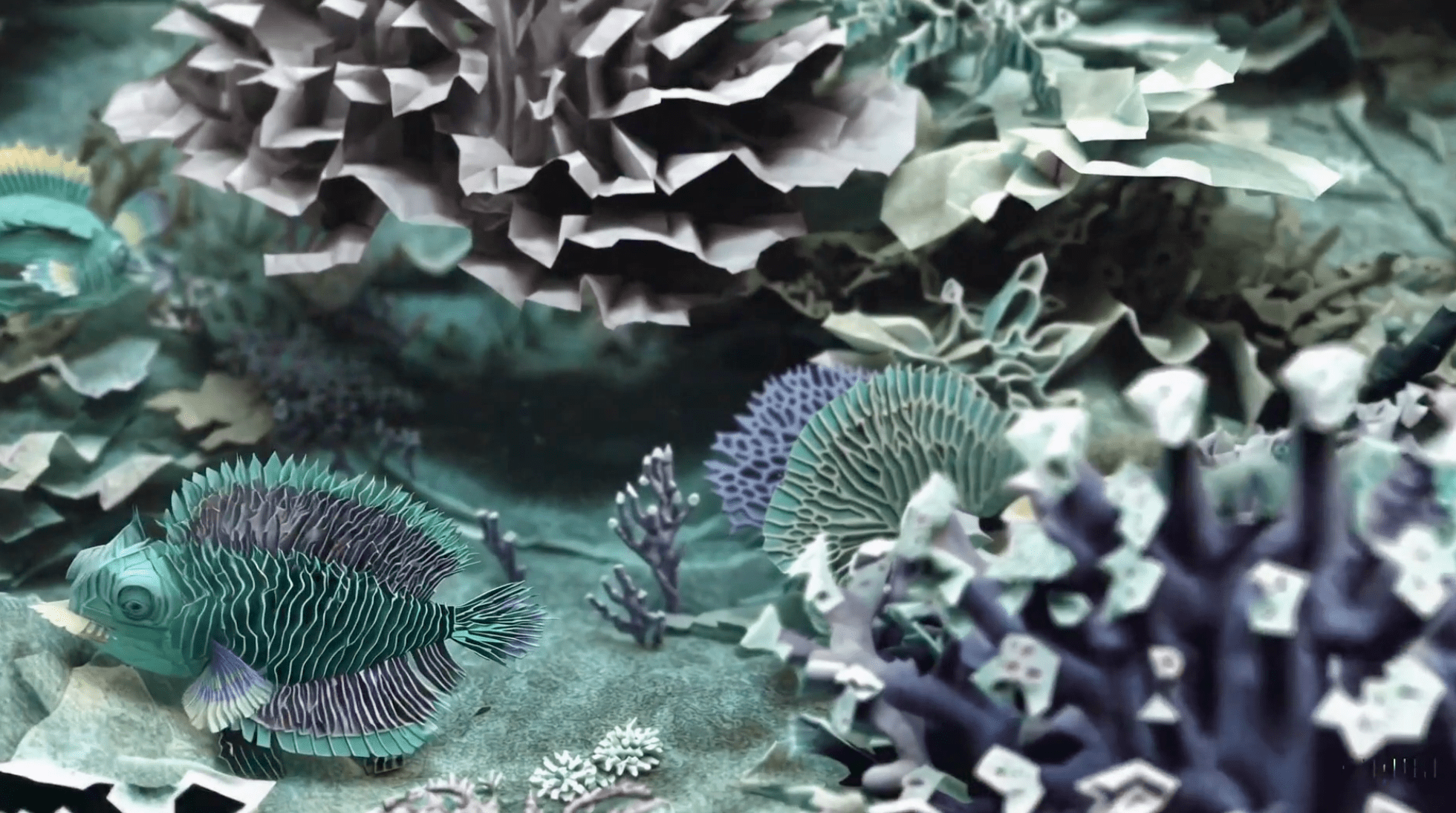

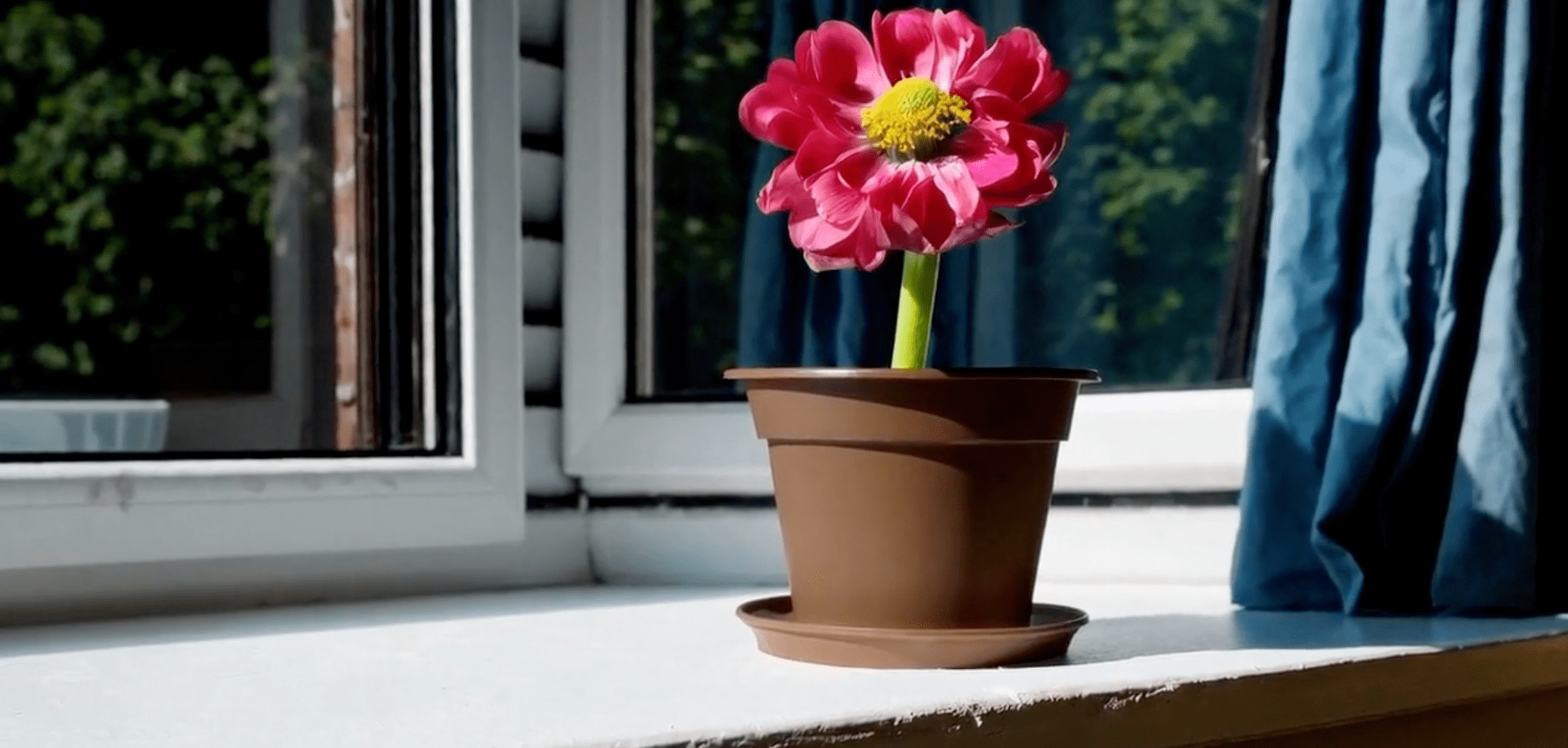

Sora consegue criar cenas complexas com vários personagens, diferentes padrões de movimento e detalhes precisos do tema e do cenário. Mais do que interpretar comandos, entende as nuances dos elementos como se manifestam no mundo real, garantindo realismo ímpar.

Usando sua profunda compreensão da linguagem, o modelo interpreta comandos e cria personagens cativantes cheios de emoções. O Sora integra múltiplas cenas em um vídeo, garantindo consistência no visual e nos personagens.

O modelo atual tem certas limitações. Pode ter dificuldades em simular a física de cenas complexas ou perder relações de causa e efeito. Por exemplo, a pessoa pode morder um biscoito, mas pode não haver marca de mordida no quadro seguinte.

Ainda, pode ter problemas com orientação espacial nas descrições e confundir esquerda e direita. A descrição de eventos no tempo, como seguir o trajeto de uma câmera, também pode ser um desafio.

O Sora usa um modelo de difusão, refinando vídeos a partir de ruído estático. Ele prevê múltiplos quadros, garantindo consistência dos personagens. Com arquitetura transformer similar ao GPT, Sora representa dados visuais como blocos, aumentando a escalabilidade. Conta ainda com recaptioning do DALL·E 3 para interpretar instruções textuais. Sora pode gerar vídeos por texto, animar imagens estáticas e estender vídeos existentes. Este modelo é um passo à Inteligência Artificial Geral (AGI). Saiba mais aqui: https://openai.com/sora

Infelizmente, até 16 de fevereiro de 2024, o modelo Sora texto-para-vídeo da OpenAI não está disponível ao público. Atualmente, a OpenAI o utiliza para pesquisa interna, sem previsão de lançamento aberto.

Acesso limitado: A OpenAI compartilhou o Sora inicialmente com "red teamers" (especialistas em desinformação e viés) e alguns profissionais criativos para avaliação.

Disponibilidade futura: A OpenAI pretende divulgar os avanços e talvez permitir acesso futuramente, mas não há planos concretos anunciados.

Opções alternativas: Algumas ferramentas oferecem geração texto-para-imagem ou animação, como Dream by WOMBO, NightCafe Creator e DALL-E 2 (acesso restrito). Porém, nenhuma ainda cria vídeos completos como o Sora. Enquanto o uso direto do Sora não é possível, você pode:

Fique atento: Acompanhe o blog e as redes sociais da OpenAI para atualizações sobre o acesso ao Sora. Explore alternativas: Teste as opções de texto-para-imagem acima e conheça a tecnologia. Saiba mais: Leia artigos e veja vídeos sobre as capacidades e o potencial do Sora (como os links já compartilhados). Mesmo sem acesso ainda, é empolgante observar o avanço e o que o futuro reserva para o Sora.