Что такое Sora? AI-модель текст-видео?

Мы обучаем AI понимать и воспроизводить динамику физического мира — цель создания моделей для помощи людям в решении задач, требующих реального взаимодействия.

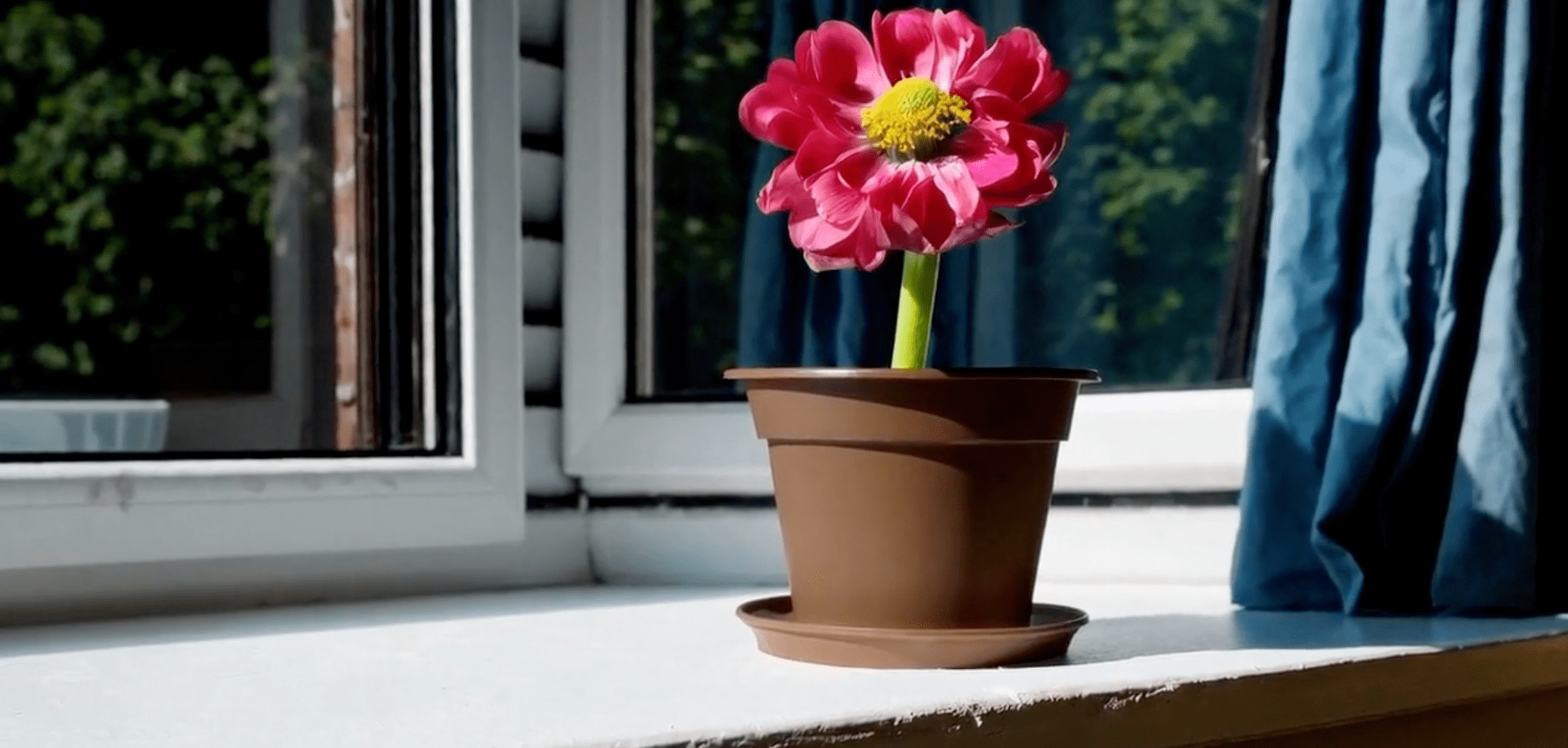

Эта AI-модель, название которой переводится с японского как «небо», может создавать реалистичные и воображаемые видео по тексту.

Мы обучаем AI понимать и воспроизводить динамику физического мира — цель создания моделей для помощи людям в решении задач, требующих реального взаимодействия.

Сегодня Sora выходит на первый план: доступ открыли экспертам, чтобы выявить уязвимости и риски в важных областях. Но это не все. Мы также приглашаем визуальных мастеров, дизайнеров и кинематографистов принять участие в формировании Sora, чтобы инструмент стал незаменимым для творцов.

Открывая исследование раньше срока, мы не просто зовем к сотрудничеству — мы создаем динамичный обмен идеями за пределами OpenAI. Это не просто очередной AI, а источник новых идей и вдохновения.

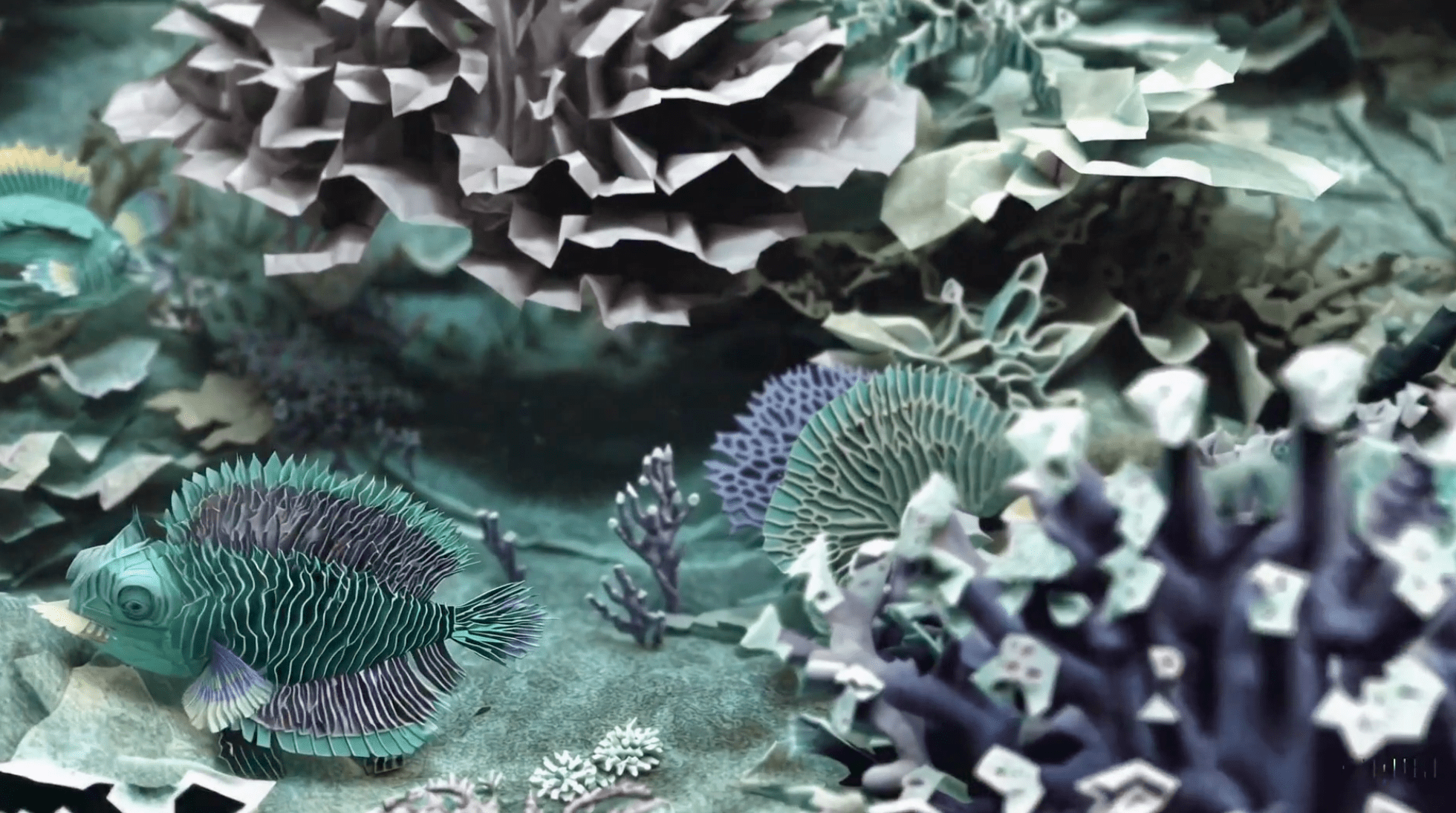

Sora способна создавать сложные сцены с несколькими персонажами, разными траекториями движения и деталями как объектов, так и фона. Модель понимает не просто подсказки пользователя, но и нюансы реального мира для максимальной реалистичности.

Используя глубокое понимание языка, Sora интерпретирует подсказки и создает колоритных персонажей с яркими эмоциями. Она может включать множество планов в одном ролике, обеспечивая целостность сюжета и визуального стиля.

У модели есть ограничения: сложная физика и причинно-следственные связи воспроизводятся не всегда. Например, если человек кусает печенье, след от укуса может не сохраниться в следующем кадре.

Кроме того, бывают трудности с пространственными ориентирами (лево/право) и последовательным воспроизведением событий во времени, например, точная траектория камеры.

Sora использует диффузионную модель, «чистит» видео из шума. Она формирует множество кадров, обеспечивая последовательность. Архитектура трансформера позволяет кодировать изображение как патчи, как в GPT, что отлично масштабируется. Используются промты из DALL·E 3 для точной интерпретации пожеланий пользователя. Sora может генерировать видео по тексту, анимировать изображения и продолжать готовые ролики. Это фундамент для ИИ следующего поколения и шаг к AGI. Подробнее: https://openai.com/sora

К сожалению, на 16 февраля 2024 года модель Sora text-to-video публично недоступна. Сейчас она используется для внутренних исследований, дата открытия пока неизвестна.

Ограниченный доступ: Sora изначально предоставили «red teamers» (специалистам по дезинформации, этике и т.д.) и отобранным креативщикам.

Будущая доступность: OpenAI планирует рассказать о прогрессе и, возможно, открыть Sora широкой аудитории, однако конкретных сроков не названо.

Альтернативы: уже есть инструменты для генерации изображений и анимации по тексту, такие как Dream by WOMBO, NightCafe Creator или DALL-E 2 (ограниченный доступ). Но настоящих видео, как у Sora, они пока не создают. Вы можете:

Следить за блогом и соцсетями OpenAI для обновлений, пробовать альтернативные AI-инструменты, читать статьи и смотреть видео о возможностях Sora. Хотя сейчас ей пользоваться нельзя, развитие этой технологии вдохновляет.