Qu'est-ce que Sora ? Un modèle IA de texte vers vidéo ?

Nous entraînons l’IA à comprendre et reproduire la dynamique du monde physique, afin de créer des modèles qui aident à résoudre des problèmes du réel.

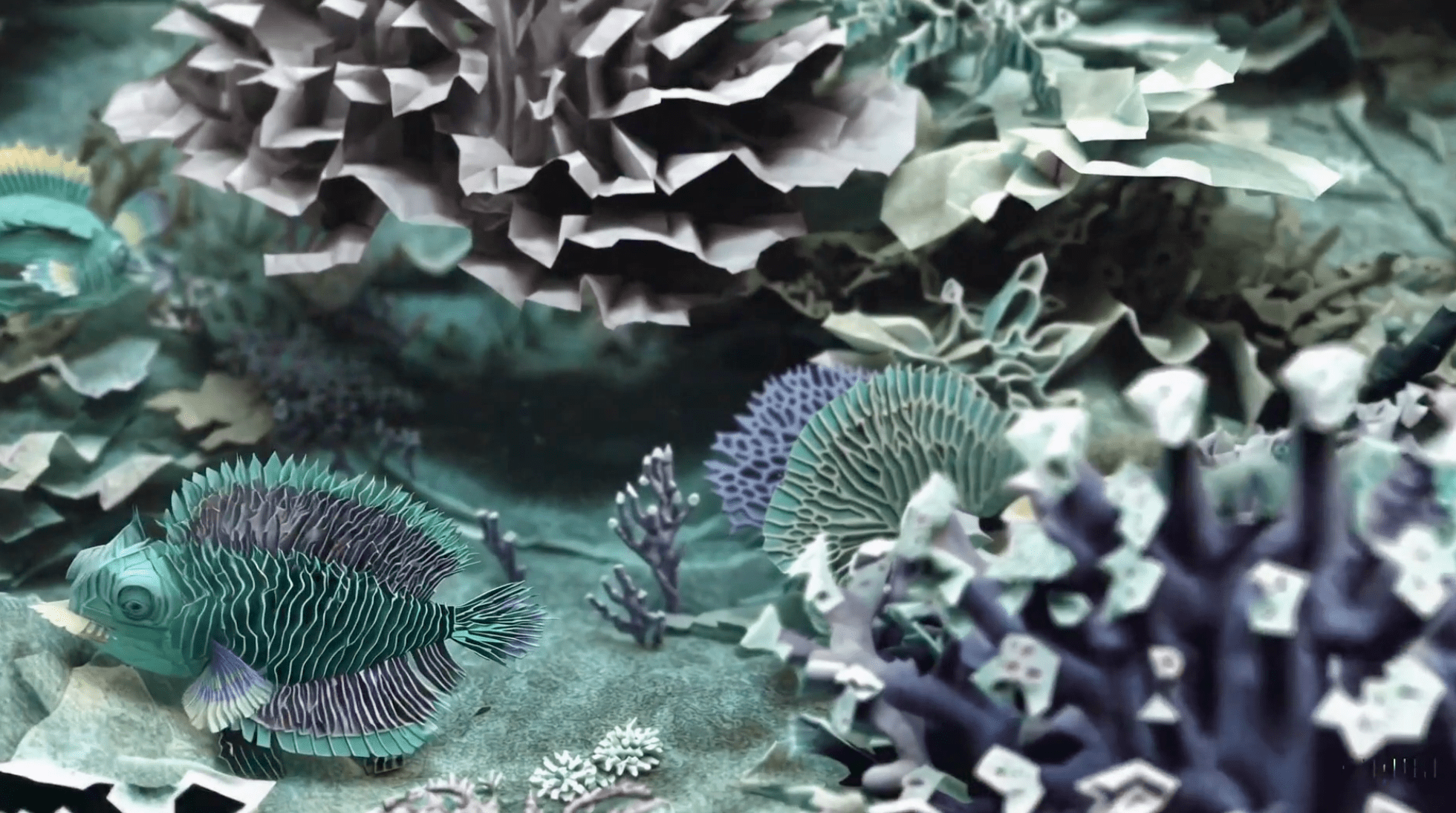

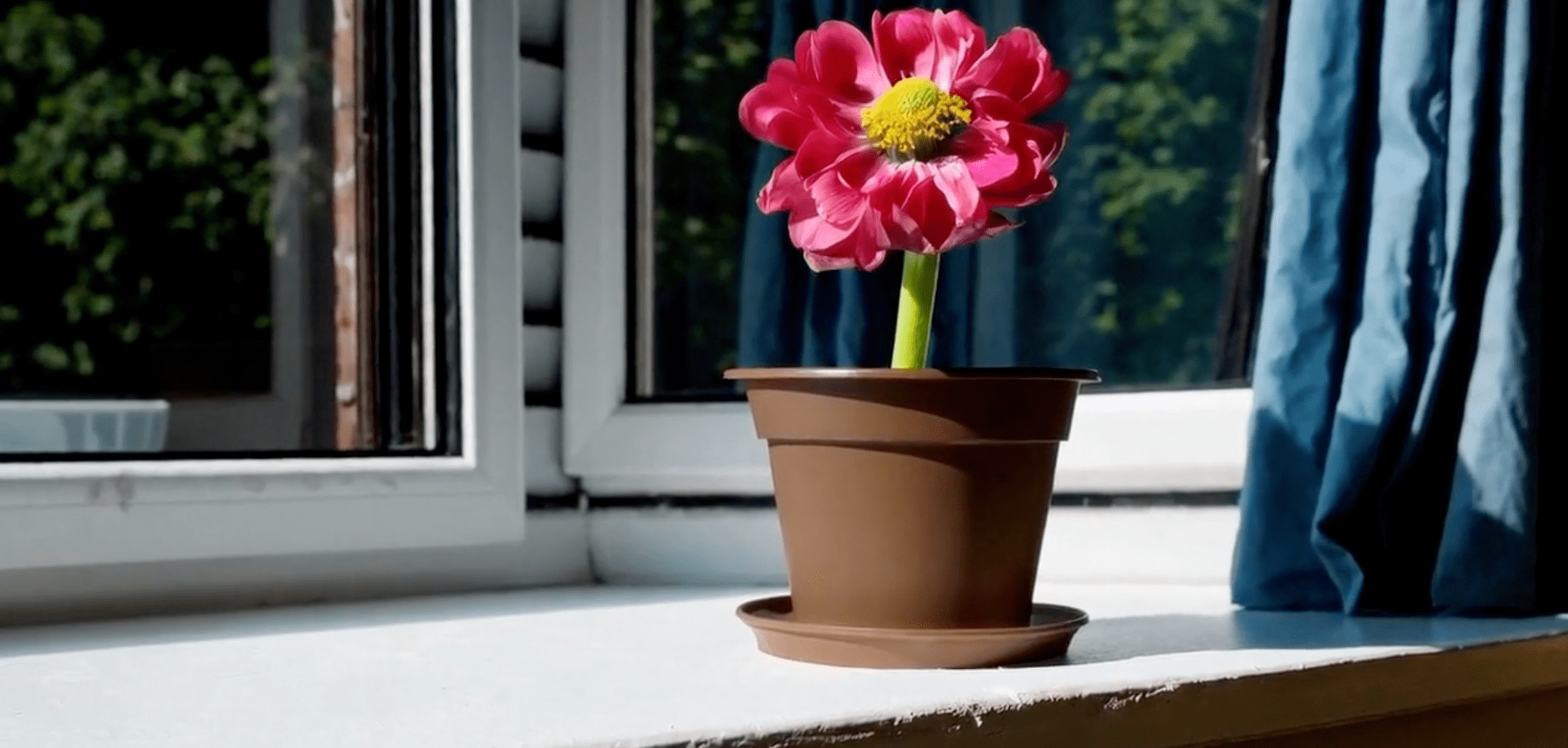

Ce modèle d’IA, nommé d’après le mot japonais « ciel », peut créer des vidéos réalistes et imaginatives à partir de descriptions textuelles.

Nous entraînons l’IA à comprendre et reproduire la dynamique du monde physique, afin de créer des modèles qui aident à résoudre des problèmes du réel.

Aujourd’hui marque une étape-clé avec l’arrivée de Sora, d’abord en test auprès d’experts pour identifier les risques. Mais ce n’est pas tout : nous invitons aussi créatifs et narrateurs à participer à son évolution et en faire un outil incontournable.

En ouvrant cette recherche à l’avance, nous favorisons les échanges d’idées, pas seulement entre chercheurs OpenAI. Plus qu’une prouesse technologique, il s’agit d’allumer l’imagination et d’entrevoir de nouveaux possibles.

Sora sait créer des scènes complexes avec plusieurs personnages, divers mouvements et beaucoup de détails. Le modèle comprend non seulement la requête utilisateur, mais aussi les subtilités du monde réel pour un réalisme inédit.

Grâce à sa maîtrise de la langue, il interprète précisément les prompts et crée des personnages expressifs. Sora peut enchaîner plusieurs plans dans une même vidéo tout en conservant la cohérence visuelle et narrative.

Le modèle a des limites : il peut avoir du mal à simuler la physique complexe ou ignorer certaines conséquences. Par exemple, si une personne mord dans un biscuit, la trace de la morsure pourrait ne pas apparaître.

Des problèmes d’orientation spatiale subsistent parfois (confusions gauche/droite) ou pour la description précise d’événements qui se déroulent dans le temps.

Sora fonctionne en affinant progressivement une vidéo depuis un bruit (diffusion). Il prédit plusieurs images, assure la cohérence du sujet, et emploie une architecture transformeur comme GPT pour traiter les données visuelles. DALL·E 3 contribue à une interprétation fidèle des instructions. Sora génère des vidéos depuis du texte, anime des images fixes et prolonge des vidéos existantes. Ce modèle fondateur fait progresser la compréhension du réel, étape-clé vers l’AGI. Plus d’infos : https://openai.com/sora

Malheureusement, au 16 février 2024, le modèle Sora n’est pas accessible au public. Il est en phase de recherche et de test, avec aucune date annoncée de lancement.

Accès limité : Sora est d’abord partagé avec des "red teamers" (experts en désinformation/biais…) et des professionnels créatifs.

Disponibilité future : OpenAI communique sur les progrès et prévoit éventuellement de l’ouvrir au public, sans calendrier précis.

Alternatives : certains outils proposent la génération image ou animation par texte, comme Dream by WOMBO, NightCafe Creator ou DALL-E 2 (accès limité). Ceux-ci ne réalisent pas encore de vidéos complètes comme Sora. En attendant, vous pouvez :

Restez informé : suivez le blog et les réseaux d’OpenAI. Essayez des alternatives pour découvrir les technologies. Consultez articles et vidéos sur Sora pour mesurer son potentiel. Même si l’accès n’est pas encore ouvert, l’évolution de Sora sera passionnante à suivre.